KI-Nutzungsstufen – Vom Werkzeug zur organisationalen Rolle

Ein zentrales Missverständnis in vielen Organisationen besteht darin, KI weiterhin ausschließlich als Werkzeug zu betrachten – also als etwas, das Menschen bedienen, steuern und kontrollieren, ähnlich wie Textverarbeitung, Tabellenkalkulation oder Maschinen. Dieses Verständnis greift jedoch spätestens dann zu kurz, wenn KI nicht mehr nur Informationen liefert, sondern kommuniziert, Vorschläge macht, Entscheidungen vorbereitet oder selbstständig handelt. Ab diesem Punkt verändert sich nicht nur die Arbeit, sondern auch die Verantwortungslogik der Organisation.

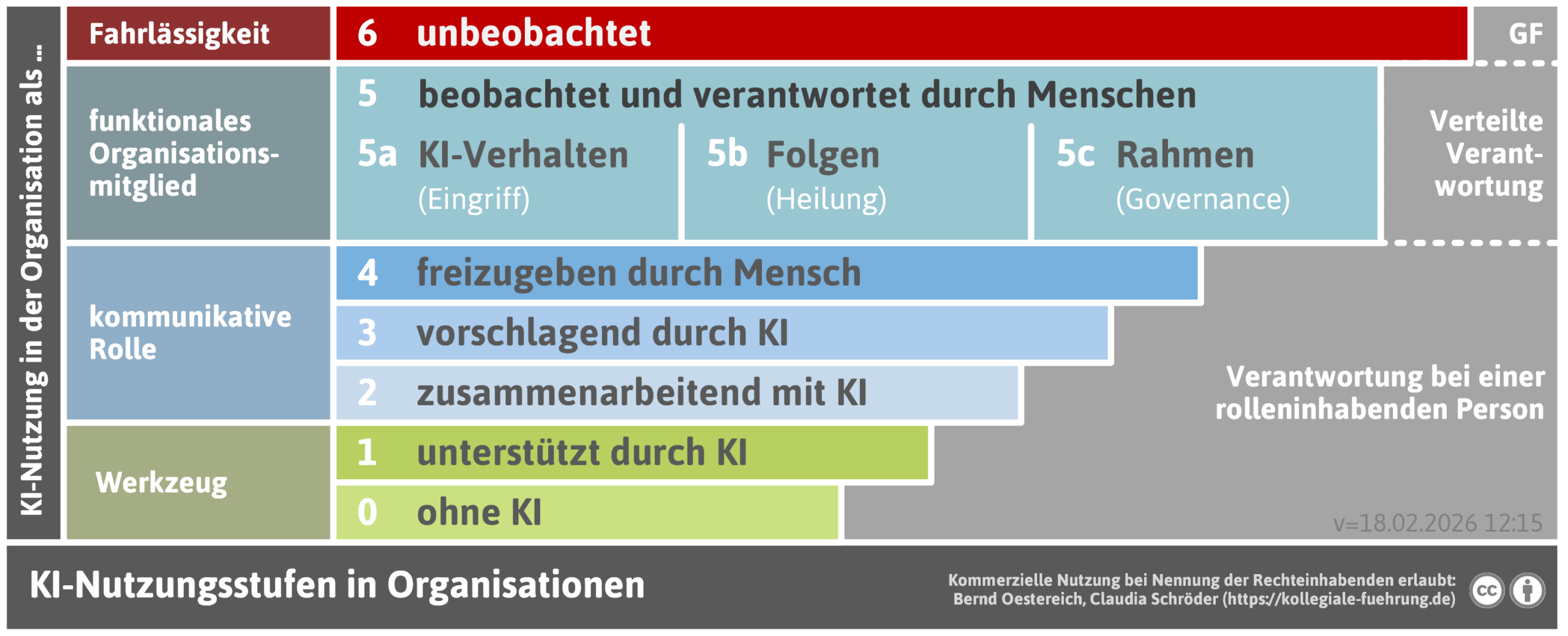

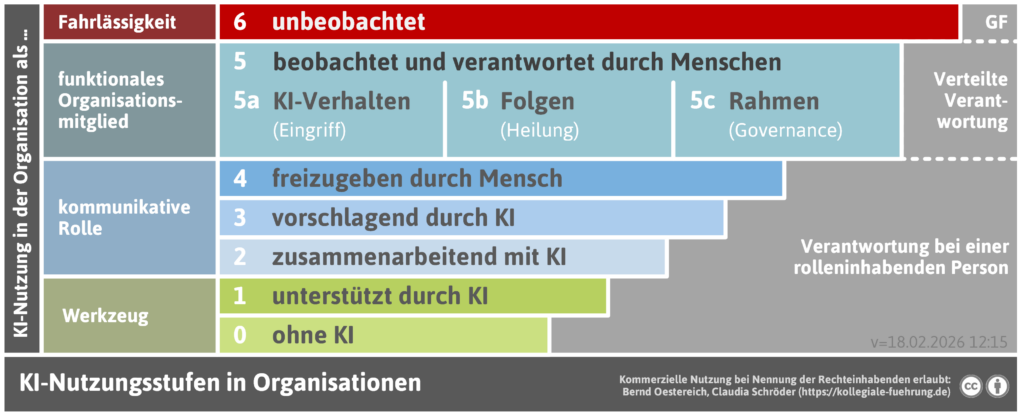

Deshalb schlagen wir hier als Diskussions- und Gestaltungsgrundlage die in der Abbildung dargestellten KI-Nutzungsstufen in Organisationen vor, die wir hier näher erläutern.

Stufen 0 und 1: Keine oder einfache Werkzeugnutzung

In Stufe 0 wird keine KI genutzt. Alle Entscheidungen, Handlungen und Verantwortlichkeiten liegen vollständig bei Menschen.

Stufe 1 – unterstützt durch KI beschreibt eine Nutzung, wie sie Organisationen seit Jahrzehnten kennen: Werkzeuge unterstützen Menschen bei ihrer Arbeit. Die KI liefert Informationen, Vorschläge oder Vorarbeiten, bleibt aber klar ein passives Hilfsmittel. Die Verantwortung liegt eindeutig bei der nutzenden Person. Fehler, Verzerrungen oder Fehlentscheidungen sind dieser Person zuzurechnen.

In diesen beiden Stufen ändert sich organisatorisch wenig. Es gibt keinen Anlass, bestehende Rollen, Entscheidungswege oder Verantwortungsstrukturen zu hinterfragen.

Stufen 2 bis 4: KI als sozial-kommunikative Rolle

Mit Stufe 2 – zusammenarbeitend mit KI beginnt ein qualitativer Sprung. Die KI wird nicht mehr nur bedient, sondern tritt als dialogfähige, sozial-kommunikative Rolle auf. Sie beantwortet Fragen, strukturiert Inhalte, reflektiert, argumentiert oder simuliert Perspektiven. Menschen erleben die KI zunehmend als Gegenüber.

In Stufe 3 – vorschlagend durch KI geht die KI einen Schritt weiter: Sie entwickelt eigenständig Vorschläge, priorisiert Optionen oder empfiehlt Handlungen. Auch wenn die Entscheidung weiterhin beim Menschen liegt, beeinflusst die KI bereits aktiv den Entscheidungsraum.

Stufe 4 – freizugeben durch Mensch markiert eine weitere Verschiebung. Die KI bereitet Handlungen oder Entscheidungen so weit vor, dass sie nach einer formalen menschlichen Freigabe wirksam werden. Die Verantwortung liegt weiterhin eindeutig bei einer rolleninhabenden Person – allerdings verändert sich deren Tätigkeit: weniger selbst entscheiden, mehr prüfen, bewerten und freigeben.

In den Stufen 2 bis 4 ist KI kein bloßes Werkzeug mehr, sondern eine kommunikative Rolle, die Kommunikation strukturiert, Erwartungen erzeugt und Handlungen vorbereitet. Organisatorisch bleibt die Verantwortung jedoch noch klar einer menschlichen Rolle zugeordnet. Genau deshalb wirken diese Stufen oft zunächst unproblematisch.

Stufe 5: Autonome KI und verteilte Verantwortung

Mit Stufe 5 – beobachtet durch Menschen wird eine Schwelle überschritten. Die KI handelt nun autonom innerhalb eines vorgegebenen Rahmens. Menschen greifen nicht mehr regelmäßig steuernd ein, sondern beobachten, überwachen und intervenieren nur bei Bedarf. Damit verändert sich die Verantwortungslogik grundlegend.

Stufe 5 ist bewusst in drei Aspekte unterteilt:

- Beobachtung des KI-Verhaltens (Intervention): Menschen beobachten das laufende Handeln der KI und greifen bei Abweichungen oder Risiken ein.

- Verantwortung der Folgen (Wiedergutmachung): Menschen übernehmen Verantwortung für die Auswirkungen des KI-Handelns, etwa für Korrekturen, Schäden oder unbeabsichtigte Nebenfolgen.

- Verantwortung des Rahmens (Governance): Menschen verantworten die Regeln, Ziele, Datenquellen und Grenzen, innerhalb derer die KI handelt.

Diese Unterscheidung macht sichtbar: Verantwortung ist nicht verschwunden, sondern verteilt. Sie liegt nicht mehr exklusiv bei einer einzelnen menschlichen Rolle, sondern über mehrere Rollen, Ebenen und Organisationseinheiten hinweg. Genau hier entstehen neue organisatorische Spannungen.

Viele Organisationen versuchen, Stufe 5 mit Mitteln aus Stufe 4 zu bewältigen – also mit individuellen Freigaben, persönlichen Haftungszuschreibungen oder impliziten Zuständigkeiten. Das führt zwangsläufig zu Überforderung, Verantwortungsdiffusion oder informellen Machtverschiebungen.

Stufe 5 ist daher keine technische Herausforderung, sondern eine organisatorische Gestaltungsaufgabe.

Stufe 6: Unbeobachtete KI – ein Organisationsversagen

Stufe 6 – unbeobachtet beschreibt keinen erstrebenswerten Zustand, sondern einen, der vermieden werden sollte. Hier handelt KI autonom, ohne wirksame menschliche Beobachtung, Eingriffsmöglichkeit oder klar geregelte Verantwortung.

In solchen Fällen lässt sich Verantwortung nicht mehr sinnvoll verteilen. Sie fällt im Zweifel auf die oberste Führung der Organisation zurück und stellt möglicherweise eine (grobe?) Fahrlässigkeit dar. Unbeobachtete KI ist daher kein Zeichen von Fortschritt, sondern von fehlender organisationaler Einbettung.

Fazit: KI als funktionales Organisationsmitglied

Die Abbildung zeigt: Je autonomer KI handelt, desto weniger reicht es, sie als Werkzeug zu behandeln. Ab Stufe 2 ist KI eine sozial-kommunikative Rolle. Ab Stufe 5 wird sie faktisch zu einem funktionalen Organisationsmitglied, dessen Handeln nicht individuell, sondern nur noch organisational verantwortet werden kann.

Die zentrale Frage lautet daher nicht: Was kann KI?

Sondern: Wie organisiert eine Organisation Verantwortung, wenn KI handelt?

In unserem Modell der Kollegialen Führung verstehen wir KI nicht als Ersatz für Menschen, sondern als neue Rolle, die eingebettet, gerahmt und verantwortet werden muss – ähnlich wie menschlich besetzte Rollen, Kreise oder andere Organisationseinheiten. Genau darin liegt die eigentliche Führungs- und Organisationsaufgabe beim Einsatz von KI in Organisationen.

Hinweis: in der ersten Fassung dieses Beitrages hatte ich den Begriff “Akteur” statt “Rolle” verwendet. Ein Akteur ist jedoch ein handelndes Subjekt, es impliziert eine eigenständige Handlungsträgerschaft, Intentionalität und die Zuschreibbarkeit von Verantwortung – genau das ist eine KI aus systemtheoretischer Sicht nicht.

In systemtheoretischer Terminologie sind Organisationen keine Ansammlung von Akteuren, sondern Netzwerke von kommunikativen Erwartungen. Deswegen die Änderung zu “Rolle”.